Un rapport alerte sur les risques pour l’intelligence artificielle de tomber entre de mauvaises mains

Un rapport alerte sur les risques pour l’intelligence artificielle de tomber entre de mauvaises mains

Le Monde.fr avec AFP

Vingt-six experts s’inquiètent que l’IA facilite la manipulation d’élections et renforce la cybercriminalité avec l’utilisation de drones ou de robots à des fins terroristes.

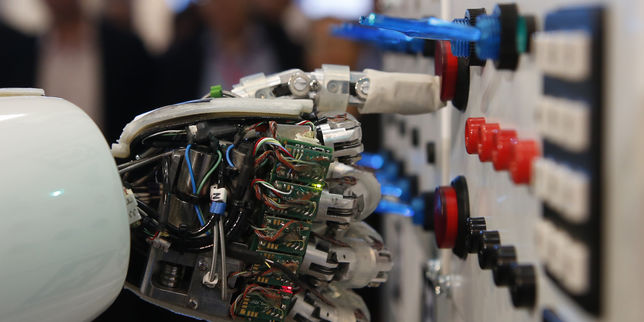

Le scénario de drones ou de robots détournés à des fins terroristes continue d’inquiéter. Des experts internationaux sonnent l’alarme sur les risques d’une utilisation malveillante de l’intelligence artificielle (IA) par « des États voyous, des criminels, des terroristes », dans un rapport publié mercredi 21 février. Selon eux, dans les dix prochaines années, l’efficacité croissante de l’IA risque de renforcer la cybercriminalité mais aussi de faciliter la manipulation d’élections via les réseaux sociaux grâce à des comptes automatisés (bots).

Rédigé par 26 experts spécialistes en intelligence artificielle, cybersécurité et robotique qui appartiennent à des universités (Cambridge, Oxford, Yale, Stanford) et à des organisations non gouvernementales, ce rapport de 100 pages appelle les gouvernements et les différents acteurs concernés à mettre en place des parades pour limiter les menaces potentielles liées à l’intelligence artificielle.

« Nous pensons que les attaques qui seront permises par l’utilisation croissante de l’IA seront particulièrement efficaces, finement ciblées et difficiles à attribuer. »

Le cas d’un robot nettoyeur trafiqué

Pour illustrer leurs craintes, ces spécialistes évoquent plusieurs « scénarios hypothétiques » d’utilisation mal intentionnée de l’IA. Ils soulignent que des terroristes pourraient modifier des systèmes d’IA disponibles dans le commerce (drones, véhicules autonomes), pour provoquer des crashs, des collisions ou des explosions.

Les auteurs imaginent ainsi le cas d’un robot nettoyeur trafiqué qui se glisserait subrepticement parmi d’autres robots chargés de faire le ménage dans un ministère berlinois. Un jour l’intrus passerait à l’attaque après avoir reconnu visuellement la ministre des finances. Il se rapprocherait d’elle et exploserait de façon autonome, tuant sa cible.

Par ailleurs, « la cybercriminalité, déjà fortement en hausse, risque de se renforcer avec les outils procurés par l’IA », déclare à l’Agence France-Presse (AFP) Seán Ó hÉigeartaigh, directeur du Centre for the Study of Existential Risk de l’Université de Cambridge, un des auteurs du rapport. Les attaques par hameçonnage ciblé (spear phishing) pourraient ainsi devenir beaucoup plus aisées à mener à une large échelle.

Une multiplication des mises en garde

Mais pour lui, « le risque le plus sérieux, même s’il est moins probable, est le risque politique ». « Nous avons déjà vu comment des gens se servaient de la technologie pour essayer d’interférer dans les élections et la démocratie. Si l’IA permet à ces menaces de devenir plus fortes, plus difficiles à repérer et à attribuer, cela pourrait poser de gros problèmes de stabilité politique et contribuer peut-être à déclencher des guerres », estime Seán Ó hÉigeartaigh.

Avec l’IA, il devrait être possible de réaliser des fausses vidéos très réalistes et cela pourrait être utilisé pour discréditer des responsables politiques, avertit le rapport. Les États autoritaires vont aussi pouvoir s’appuyer sur l’IA pour renforcer la surveillance de leurs citoyens, ajoute-t-il.

Ce n’est pas la première fois que des inquiétudes s’expriment concernant l’IA. Dès 2014, l’astrophysicien Stephen Hawking lançait une mise en garde sur les risques qu’elle pourrait faire courir à l’humanité, en dépassant l’intelligence humaine. L’entrepreneur Elon Musk et d’autres ont aussi tiré la sonnette d’alarme. Des rapports spécifiques sur l’utilisation de drones tueurs ou sur la façon dont l’IA pourrait affecter la sécurité des États-Unis ont également été publiés.

Ce nouveau rapport apporte « une vue d’ensemble sur la façon dont l’IA crée de nouvelles menaces ou change la nature des menaces existantes dans les domaines de la sécurité numérique, physique et politique », explique Seán Ó hÉigeartaigh.

Des progrès substantiels

Apparue dès les années 1950, l’intelligence artificielle correspond à des algorithmes sophistiqués qui permettent de résoudre des problèmes pour lesquels les humains utilisent leurs capacités cognitives. Ces dernières années, elle a fait des progrès substantiels notamment dans les domaines liés à la perception, comme la reconnaissance vocale et l’analyse d’image.

« Actuellement, il y a encore un écart important entre les avancées de la recherche et ses applications possibles. Il est temps d’agir », déclare à l’AFP Miles Brundage, chargé de recherche au Future of Humanity Institute de l’Université d’Oxford. Cet expert a animé en février 2017 à Oxford un atelier sur les risques d’un usage malveillant de l’IA, qui a donné naissance à ce rapport.

« Les chercheurs en IA, les concepteurs de robots, les compagnies, les régulateurs, les politiques doivent à présent collaborer pour tenter de prévenir » ces risques, conclut Seán Ó hÉigeartaigh.